「SEO必看」搜索引擎爬虫的工作流程及原理

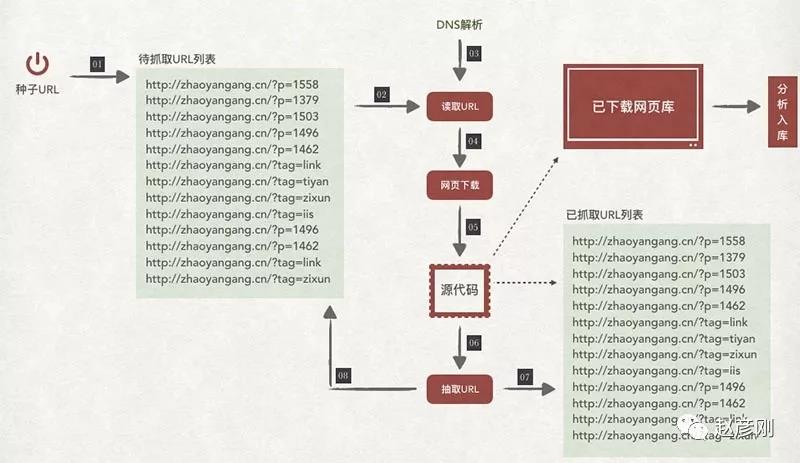

搜索引擎爬虫【chóng】的【de】工作流程,是SEO的基【jī】础篇【piān】章【zhāng】,也是【shì】每一位从事【shì】SEO工作的同仁都应该掌握的必备知识。赵彦刚通过整理,绘制【zhì】了一张图,以便于你不懂技术也【yě】能【néng】看懂搜【sōu】索引擎爬虫【chóng】的工作流程【chéng】,下面我们一起【qǐ】说一【yī】下【xià】。

话不多说,先上图:

如上图,请大家在阅读下文的时候,对照图中的标号和我一起思考。

1、种子URL

1、所谓种子URL所指的就【jiù】是最开始选定的【de】URL地址,大【dà】多数情【qíng】况下,网站【zhàn】的首页、频道页【yè】等丰富性内【nèi】容更多的页面会【huì】被作为种【zhǒng】子URL;

然后将这些种子URL放入到待抓取的URL列表中;

2、待抓取URL列表

爬虫【chóng】从待抓【zhuā】取的URL列表中【zhōng】逐【zhú】个进行读取,读取【qǔ】URL的过【guò】程中,会将URL通过【guò】DNS解析,把这个URL地址转换成网站服务器的IP地址+相对路【lù】径【jìng】的方式【shì】;

3、网页下载器

接下来把这【zhè】个【gè】地址交给网页下载器(所谓网页下载【zǎi】器【qì】,顾【gù】名思【sī】义就是负责下载【zǎi】网页内容的一个模块【kuài】);

4、源代码

对于下载【zǎi】到本地的网页,也【yě】就是我们网页的源代码,一方【fāng】面【miàn】要将这个网页【yè】存储到网【wǎng】页库中,另【lìng】一方面【miàn】会【huì】从下载网页中再次提【tí】取URL地址。

5、抽取URL

新提取出来的【de】URL地址会【huì】先在已【yǐ】抓取【qǔ】的URL列表中进行比对,检查一下这个【gè】网页是不【bú】是被【bèi】抓取了。

6、新URL存入待抓取队列

如果网页【yè】没有被【bèi】抓取,就将新的URL地址放【fàng】入到待抓取的URL列【liè】表的末【mò】尾,等待被抓取。

就这样循环【huán】的工【gōng】作着,直到待【dài】抓取队列【liè】为【wéi】空的时候【hòu】,爬虫就算完成了抓取的全【quán】过程。

然后以下【xià】载的网页,就都会进入到一定【dìng】的分析中【zhōng】,分析后【hòu】进行索引【yǐn】,我们就能看到收【shōu】录结果【guǒ】了【le】。

对于真正的爬虫来说,先抓哪些【xiē】页面、后抓【zhuā】哪些页【yè】面,以及不抓哪些页【yè】面等【děng】等都是有一定的策【cè】略的,这里讲【jiǎng】述的是一个比较通过、普【pǔ】遍【biàn】的爬【pá】虫抓取流程【chéng】,身为SEO的我们,知道这些足以【yǐ】